Объединённая Александром Пановым команда учёных Института проблем искусственного интеллекта ФИЦ ИУ РАН, Центра когнитивного моделирования МФТИ и AIRI поделилась своей новой разработкой. Это метод управления роботизированной системой, которая выполняет свои действия, опираясь на текстовые инструкции и визуальную информацию. На самом деле, мы уже бегло писали о нём в ноябре («Проект роборука»), всё это время коллектив занимался шлифовкой и доведением системы до ума, и вот, наконец, выпустил полноценный пресс-релиз с комментариями для журнала «За науку», «Известий» и CNews. Как описывает подход Алексей Староверов,

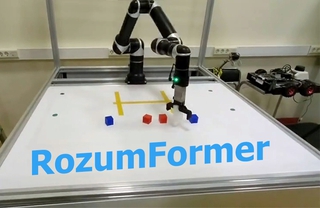

«В качестве модели мы задействовали роборуку с шестью степенями свободы. Нашей целью было научить её самостоятельно сортировать объекты на столе по цветам и собирать их в заданную область. Свои действия роборука должна была выбирать на основе текстовой инструкции и данных с видеокамер».

«Алгоритмы машинного обучения должны были ускорить этот процесс», для чего авторы применяли языковые модели вроде тех, что практикует чат GPT. Только в отличие от «интеллектуального чата», предобученного на массивах данных из интернета, устройство роборуки использует картины окружающей действительности, а на выходе вместо текста манипулятор выдаёт действия на основе обратной связи с видеокамер. Уникальность исследования отметил и Алексей Ковалёв:

«Новизна работы в том, что для обучения робота мы использовали готовые языковые модели — алгоритмы, которые помогают переводить естественную речь в код, понятный системе управления. Она представляют собой нейронные сети, которые предобучены на больших объёмах текстовых данных. В нашем случае была применена мультимодальная модель RozumFormer. В отличие от других, она может генерировать ответ и на текстовые запросы, и на те, которые сделаны в виде изображений».

Была проведена тонкая настройка языковой модели, для чего авторы дообучили нейронную сеть, чтобы она могла различала цвета кубиков, расстояния до них и другие параметры окружения. Настройку производили в виртуальной среде (специальном игровом пространстве), в итоге модель овладела манипулятором и стала решать задачи самостоятельно в реальном окружении. Как резюмировал сам Александр Панов,

«Языковая модель выдает гипотезу о том, что что-то произойдет, а мы превращаем её в выполнимый на роботе план. В дальнейшем модель его реализует и проверяет, достигнута цель или нет. Например, схватил манипулятор кубик или нужно еще тянуться. Для этого следует учитывать визуальную информацию. Эти данные с камер видеонаблюдения поступают в ЭВМ и переводятся на понятный машине язык».

«Робототехника изначально подразумевает мультимодальный подход к обработке информации. То есть машинному интеллекту необходимо учитывать и синхронизировать, например, кадры с видеокамер, с данными от лидаров (приборов для определения расстояний). Это обычно называется комплексированием информации. Такие задачи решаются разными методами. Однако применение для этих целей языковых моделей продемонстрировало перспективность метода».

Теперь в планах учёных — научить модель запоминать более длинные последовательности действий, что поможет системам в автономном режиме самостоятельно решать более сложные задачи, например, мыть посуду или прибираться в доме, различая комнаты и предметы и разделяя их по назначению (о чём, к слову, также рассказывал Александр Корчемный во время AIJ 2023). Комментарии экспертов Центра прикладного искусственного интеллекта Евгения Бурнаева, Института биологии и биомедицины Университета Лобачевского Марии Ведуновой и Научно-образовательного центра биомедицинской инженерии НИТУ МИСИС Александра Левина прилагаются.

Cсылки по теме:

статья в журнале «За науку»

статья в газете «Известия»

статья на портале CNews